|

编译:刘小芹、胡祥杰 :COO、执行总编、主编、高级编译、主笔、运营总监、客户经理、咨询总监、行政助理等 9 大岗位全面开放。 简历投递:j[email protected] HR 微信:13552313024 新智元为COO和执行总编提供最高超百万的年薪激励;为骨干员工提供最完整的培训体系、高于业界平均水平的工资和奖金。 加盟新智元,与人工智能业界领袖携手改变世界。 【新智元导读】谷歌研究院官方博客几小时前更新文章,介绍了一种名为“缩放卷积神经网络”的新方法,能够解决在使用反卷积神经网络生成图像时,图片中尤其是深色部分常出现的“棋盘格子状伪影”(棋盘效应,checkboard artifacts)。作者讨论了棋盘效应出现及反卷积难以避免棋盘效应的原因,并提供了缩放卷积 TensorFlow 实现的代码。作者还表示,特意提前单独公开这一技术,是因为这个问题值得更多讨论,也包含了多篇论文的成果,让我们谷歌大脑的后续大招吧。 当我们非常仔细地观察神经网络生成的图像时,经常会看到一些奇怪的棋盘格子状的伪影(artifact)。这种现象有些情况下比其他情况更明显,但最近的模型很多都会出现这种现象。

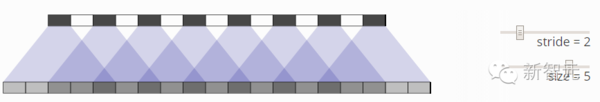

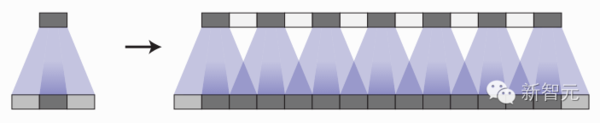

不可思议的是,这些棋盘图案在颜色深的图像中最突出。这是怎么回事?神经网络讨厌明亮的颜色吗?这些伪影出现的实际原因其实非常简单。 反卷积&重叠 当我们用神经网络生成图像时,我们经常从低分辨率、高阶描述中构建图像。这会让网络先描绘粗糙的图像,再填充细节。 因此,我们需要能让图像从较低分辨率达到较高分辨率的方法。我们通常使用反卷积操作。大致来说,反卷积层允许模型使用小图像中的每个点来“绘制”更大的图像中的方块。 【译注:反卷积有许多解释和不同的术语,包括“转置卷积”(transposed convolution);为了简洁起见,本文使用“反卷积”(deconvolution),有关反卷积的更多讨论参见:Dumoulin & Visin, 2016 and Shi, et al., 2016a.】 但是,反卷积很容易“不均匀重叠”(uneven overlap),使图像中某个部位的颜色比其他部位更深(Gauthier, 2015)。尤其是当核(kernel)的大小(输出窗口的大小)不能被步长(stride)整除时,反卷积就会不均匀重叠。虽然原则上网络可以仔细地学习权重来避免这种情况,但在实践中神经网络很难完全避免不均匀重叠。

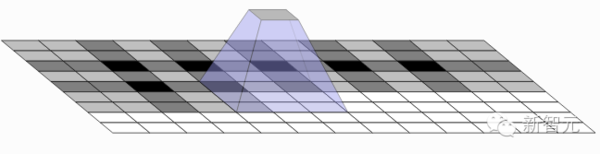

(注:在原文网站上可以调节图示的大小(size)和步长(stride)更直观地理解,下同) 重叠图案也在二维中形成。两个轴上的不均匀重叠相乘,产生不同亮度的棋盘状图案。

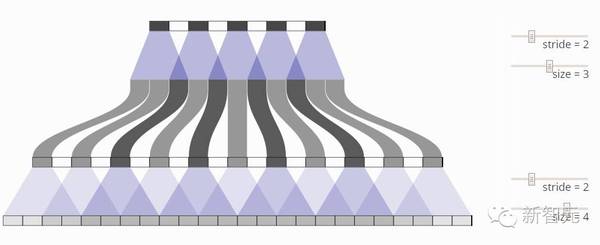

事实上,不均匀重叠往往在二维上更极端!因为两个模式相乘,所以它的不均匀性是原来的平方。例如,在一个维度中,一个步长为2,大小为3的反卷积的输出是其输入的两倍,但在二维中,输出是输入的4倍。 现在,生成图像时,神经网络通常使用多层反卷积,j2直播,从一系列较低分辨率的描述中迭代建立更大的图像。虽然这些堆栈的反卷积可以消除棋盘效应,但它们经常混合,在更多尺度上产生棋盘效应。

步长为1的反卷积层——通常被认为是成功的模型中的最后一层(eg. Salimans et al., 2016)——在减轻棋盘效应方面非常有效。它们可以消除频率整除其大小的棋盘效应,也可以减少其他频率小于其大小的棋盘效应。但是,棋盘效应仍然会发生,就像最近的模型出现的。 除了我们在上文观察到的高频棋盘状伪影外,atv,早期的反卷积可以产生较低频率的伪影,我们将在后文更详细地探讨。 重叠&学习 不均匀重叠虽然是有效的框架,也可以说它是一种简单化。无论好坏,模型要为它们的反卷积学习权重。 理论上,模型可以学习仔细地写入不均匀重叠的位置,以使输出均匀平衡。

|